با یادگیری عمیق، میتوانید به دنیای هیجانانگیز هوش مصنوعی قدم بگذارید و در حل چالشهای پیچیده نقش مهمی ایفا کنید. در واقع، تسلط بر این حوزه گام کلیدی در فرآیند آموزش هوش مصنوعی محسوب میشود. با شرکت در دوره یادگیری عمیق و شبکه عصبی، شما میتوانید به صورت کاملاً اصولی طی ۱۷ جلسه با پایه و اساس این فناوری آشنا شوید. این جلسات به صورت مرحلهبهمرحله و ویدیویی در اختیار شما قرار گرفته تا بهترین نتایج را دریافت کنید.

شما قبلا در این دوره ثبت نام کرده اید

رایگان

صابر کلاگر

6 ساعت

ندارد

ندارد

آنلاین در سایت

دارد

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

این درس قفل است. برای دسترسی، ابتدا ثبت نام کنید.

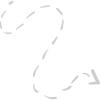

یادگیری عمیق زیرمجموعهای از یادگیری ماشین و شاخهای از هوش مصنوعی است که به ماشینها اجازه میدهد تا با استفاده از دادههای حجیم و الگوریتمهای پیچیده، یاد بگیرند و وظایف پیچیده را انجام دهند.

شبکههای عصبی، ستون فقرات یادگیری عمیق هستند. این شبکهها از لایههای متعددی از نورونها تشکیل شدهاند که به هم متصل هستند و میتوانند الگوهای پیچیده را در دادهها شناسایی کنند.

با یادگیری عمیق، میتوانید به دنیای هیجانانگیز هوش مصنوعی قدم بگذارید و در حل چالشهای پیچیده نقش مهمی ایفا کنید. در واقع، تسلط بر این حوزه گام کلیدی در فرآیند آموزش هوش مصنوعی محسوب میشود. با شرکت در آموزش یادگیری عمیق و شبکه عصبی، شما میتوانید به صورت کاملاً اصولی طی ۱۷ جلسه با پایه و اساس این فناوری آشنا شوید. این جلسات به صورت مرحلهبهمرحله و ویدیویی در اختیار شما قرار گرفته تا بهترین نتایج را دریافت کنید. پس همین الان شروع کنید…

آموزش رایگان یادگیری عمیق مزایای بسیار زیادی برای افراد فعال این زمینه دارد. یادگیری عمیق در صنایع مختلف به طور گسترده مورد استفاده قرار میگیرد، زیرا این علم روز به روز در حال توسعه است. برای مثال در صنعت از یادگیری عمیق برای اتوماسیون صنعتی در کنترل کیفیت محصولات، بستهبندی، تشخیص قطعات و بازوهای رباتیک استفاده میشود. در صنایع غذایی یادگیری عمیق میتواند برای بازرسی محصولات، تشخیص ناهنجاریها، شمارش اشیا و بررسی کامل بودن بستهبندی به کار برود. در بخش خودروسازی و تولیدی الگوریتمهای یادگیری عمیق برای پردازش دادههای بزرگ، ارائه گزارشهای مربوط به روند تولید، ایجاد هشدارهای خودکار و پشتیبانی از سیستمهای نگهداری پیشبینی مورد استفاده قرار میگیرند.

علاوه بر این موارد یادگیری عمیق در سایر حوزهها مانند امنیت سایبری، هوافضا، بیمه و هوش تجاری نیز کاربرد دارد. در هوش تجاری، یادگیری عمیق میتواند در تحلیل رفتار مشتری، پیشبینی فروش و تقاضا، شناسایی الگوهای مصرف مشتریان، تشخیص تقلب و مدیریت ریسک مورد استفاده قرار بگیرد. همچنین در حوزه سرگرمی، یادگیری عمیق برای بهبود تجربه کاربری، پیشنهاد محتوا، افزودن صدا به فیلمهای بیصدا و ایجاد زیرنویس خودکار کاربرد دارد. در بخش رباتیک نیز یادگیری عمیق به ساخت رباتهایی کمک میکند که قادر به انجام وظایف شبیه به انسان هستند. توجه داشته باشید که قبل از شرکت در دوره آموزش رایگان یادگیری عمیق باید تفاوت یادگیری ماشین و یادگیری عمیق را بدانید.

بعد از آموزش رایگان یادگیری عمیق افراد میتوانند در شرکتهای فناوری، موسسات پژوهشی و استارتاپها مشغول به کار شوند. در این دورهها یادگیری انتقالی و لایههای پنهان علم یادگیری عمیق نیز اموزش داده میشود. همچنین مهندسان یادگیری عمیق با طراحی، پیادهسازی و آموزش شبکههای عصبی مصنوعی، به حل مسائل پیچیده در حوزههایی مانند تشخیص تصویر، پردازش زبان طبیعی و تحلیل دادههای بزرگ کمک میکنند. البته برای موفقیت در این مسیر داشتن مهارتهای اساسی در یادگیری ماشین، حل مسئله، تفکر پژوهشی، بصریسازی و ارائه نتایج ضروری است.

توجه داشته باشید که برای ورود به این حوزه یادگیری مهارتهای اساسی، کار بر روی پروژهها برای تعمیق مهارتها و ایجاد پورتفولیو و یافتن شغل، سه گام کلیدی هستند. همچنین تسلط بر زبانهای برنامهنویسی مانند پایتون و فریمورکهای یادگیری عمیق مانند TensorFlow و PyTorch، و توانایی نوشتن کد برای پیادهسازی سیستمهای هوش مصنوعی پیچیده، موجب میشوند افراد فرصتهای شغلی بهتری داشته باشند.

برای اینکه از دوره آموزش رایگان یادگیری عمیق نهایت استفاده را ببرید، باید پیشزمینههایی در چند زمینه کلیدی داشته باشید. ابتدا لازم است مفاهیم پایه یادگیری ماشین، مانند انواع الگوریتمها، روشهای ارزیابی مدل و فرآیند کلی توسعه یک مدل یادگیری ماشین را یاد بگیرید. این آشنایی به شما کمک میکند تا مطالب دوره را بهتر درک کرده و بتوانید آنها را در پروژههای عملی به کار ببرید. علاوه بر دانش یادگیری ماشین، تسلط نسبی بر برنامه نویسی پایتون، جبر خطی، آمار و احتمال نیز اهمیت دارد. پایتون زبان اصلی مورد استفاده در یادگیری ماشین است و آشنایی با آن به شما امکان میدهد تا الگوریتمها را پیادهسازی کرده و با دادهها کار کنید. جبر خطی و آمار و احتمال نیز مبانی ریاضی مورد نیاز برای درک عمیقتر الگوریتمها و تجزیه و تحلیل دادهها را فراهم میکنند. با داشتن این پیشزمینهها، میتوانید به راحتی در این دوره شرکت کرده و مهارتهای خود را در زمینه یادگیری ماشین ارتقا دهید.

شما می توانید جهت دریافت مشاوره رایگان دورهها، درخواست مشاوره خود را برای ما ارسال کنید تا ما با شما تماس بگیریم.

نامشخص

۱۶,۷۰۰,۰۰۰ تومان قیمت اصلی: ۱۶,۷۰۰,۰۰۰ تومان بود.۱۲,۵۲۵,۰۰۰ تومانقیمت فعلی: ۱۲,۵۲۵,۰۰۰ تومان.

60+ ساعت

۱۰,۹۰۰,۰۰۰ تومان قیمت اصلی: ۱۰,۹۰۰,۰۰۰ تومان بود.۸,۱۷۵,۰۰۰ تومانقیمت فعلی: ۸,۱۷۵,۰۰۰ تومان.

دیدگاهها

فاطمه –

استاد این دوره خیلی عالی بود، واقعا ممنونم که چنین دوره باارزشی رو رایگان در اختیارمون گذاشتین، ممنونم از زحماتتون

ma par –

خیلی عالی بود.من هر چی مقاله تو این زمینه خوندم انقدر کمک نکرد.واقعا از استاد این مباحث ممنونم

sanaz –

فن بیان و انتقال مطالبتون عالیه استاد کلاگر عزیز، هیچوقت فکر نمیکردم این مسائل رو بتونم به این خوبی درک کنم، بسیار متشکرم

صادق نظارات –

واقعا عالی بود استاد

دست شما درد نکنه، خدا خیرتون بده واقعا.

❤❤❤

سید محمد جواد برقعی –

دوره بسیار مفیدی هستش و برای شروع به همه دوستان توصیه میکنم این دوره رو مشاهده کنند

فرنوش قمی –

سلام

خدا قوت

جسارتا با وجودی که این دوره رایگان هستش ولی به جز جلسه اول باقی جلسات قفل هستن و میگه باید دوره رو خریداری کنم، در صورتی دوره رایگان شده.

میشه راهنماییم کنید؟!

صابر کلاگر –

سلام، وقتتون بخیر

برای دسترسی به دوره ابتدا باید در دوره ثبت نام کنید،

بعد از ثبت نام وارد حساب کاربریتون بشید، ویدیوهارو ببینید و از محتوای دوره استفاده کنید.

لیلا جوادی –

سلام ممنونم از استاد عزیز آموزشاتون خیلی عالی بودن فقط کاش یک گواهی هم تعلق میگرفت به شرکت کنندگان تا در لینکدین به رزومه مون اضافه میکردیم 🙏

صابر کلاگر –

سلام و ارادت، ممنونم

بازار برای به کار گیری نیروهای فنی، بیش از اینکه به فکر گواهی باشه، به توانایی های افراد در حل مساله نگاه میکنه.

به همین دلیل تمرکز ما روی کیفیت آموزشها و خدماتی که ارائه میکنیم هست تا در مسیر توانمند شدن دانشجویان عزیزمون همراهشون باشیم. به همین دلیل تا این لحظه اقدامی برای ارائه مدارک نداشتیم.

علی –

جالب بود! چندین دوره آموزشی یادگیری عمیق و یادگیری ماشین دیدم ولی تازه اینجا فهمیدم چه خبره، مرسی استاد

mohammadpoorm721 –

سلام.

دوره ها که شرکت داشتید مانند این دوره رایگان بودند؟

عماد یوسفی –

perfect

knima –

واقعا متشکرم که شما همچین دوره کاملی رو رایگان در اختیار ما گذاشتید .

mjes1369 –

ممنون از آموزش تون

mjes1369 –

در ابتدای درس دوم از رگرسیون صحبت کردین که میفرمایید در جلسه قبل صحبت کردین ….ولی در درس 1 صحبتی نشد از این موضوع

صابر کلاگر –

بخش از ویدیو دوره مشکل داشت که از دوره برداشته شد. به همین دلیل اون نکته ای که بهش اشاره کردم در دوره نیست. در کلیت محتوای دوره کاستی ایجاد نمیکنه. مطالب جلسات رو پیوسته ببینید، متوجه تمام مطالب خواهید شد.

مصطفی –

سلام استاد بابت تهیه این دوره بسیار متشکرم از شما

استاد یک سوال داشتم در درس دوم شما فرمودید

که ثانیه 30 ویدئو درس دوم هست اما بخش قبلی اصلا چنین مواردی را تدریس نکردید اگر پیشنیازی هست قبل از این درس کدام مورد منظور هست؟؟

متشکر از زحماتتون

صابر کلاگر –

سلام، مرسی از بازخورد خوبتون

این بخشی که در دوره اشاره کردم بدلیل نقصی که در ویدیو وجود داشت حذف شده، اشاره به مباحث ریاضیاتی کردم که پایه شبکه عصبی رو تشکیل میده.

پیشنهاد میکنم ویدیوهارو پیوسته ببینید، مشکلی ایجاد نمیکنه و مطالب براتون جا میفته. اگر باز هم ابهامی بود مطرح کنید، حتما پاسخ میدم.

hilanstudio –

خیلی عالی بود. ممنون از این دوره ارزشمندی که در اختیار ما گذاشتید.

رضا نیکزاد –

فن بیان عالی، ممنونم

mohammadpoorm721 –

با سلام و احترام

از زحمات شما برای انتشار این دوره و آموزش

در انتقال مفاهیم .سپاسگزارم

mohammadpoorm721 –

سلام

وقت شما بخیر

استاد برای درس سوم شبکه عصبی چیست بخش دوم من هر چی امتحان میکردم ولی متاسفانه ویدیو صدا نداشت

آیا برای بقیه دوستان هم همینطور بوده ؟

صابر کلاگر –

سلام و ارادت

بررسی کردم مشکلی نداشت،

متاسفانه این مدت اینترنت شدیدا دچار اختلال و قطی بود و این موارد زیاد مشاهده شد،

لطفا مجدد امتحان کنید.

rsl.yeganeh2024 –

191891191316 –

سلام استاد وقت بخیر. ممنون از انتشار این دوره ارزنده و سپاس بیکران که دوره رایگان در اختیار ما قرار داده شد. بسیار لذت بردم.

parhamqorbannia –

عالی هستی استاد

parhamqorbannia –

خیلی عالی بود ممنون از شما، واقعا تونستم بعضی از مفاهیمو به صورت شهودی یاد بگیرم

حسین اسکندری –

ممنون از استاد عزیز.

پدرام افشاریان –

تمام ابهاماتی که داشتم برطرف شد، قدرت انتقال مطالب ۱۰۰۰ 😁

ممنون از استاد کلاگر عزیز

Sajjad Alizad –

با تشکر از شما و رایگان بودن آموزش سپاس

عادل آخکندی –

خیلی عالی بود ممنون از شما، واقعا تونستم بعضی از مفاهیمو به صورت شهودی یاد بگیرم

soleymani200 –

عالی. ممنون

a.gholami8448 –

سلام بابت این دوره که واقعا عالی بود تشکر خیلی محتوای خوبی و کاملی داشت . بابت انتشار رایگان این دوره ممنون.

فقط در مورد ادامه مسیر و نقشه راهی که باید طی کنیم یه توضیحی میدید .

باتشکر .

Sogol –

من به عنوان کسی که داخل اینترنت دنبال یک محتوای مناسب درباره اموزش عمیق هوش مصنوعی میگشتم که به ترتیب همه اینهارو توضیح بده و خیلی خوب باشه با سایت دیتایاد اشنا شدم

واقعا همه مطالب به ترتیب با یک لحن روان و مناسب نه کند و نه تند اموزش ها داده میشه

عمیق یاد میگیریم واقعا مانند اسم دوره :))

از مدرس محترم دوره واقعا ممنونم که وقت گذاشتن و این دوره رو حتی رایگان در اختیار همه قرار دادن. واقعا خداقوت و دستتون درد نکنه