آیا تا به حال فکر کردهاید که چگونه کامپیوترها میتوانند جهان اطراف را ببینند، تحلیل کنند و بفهمند؟ از باز شدن قفل گوشی با تشخیص چهره گرفته تا شناسایی اشیا در تصاویر ماهوارهای و تشخیص بیماریها در تصاویر پزشکی، همهی این پیشرفتها حاصل یکی از مهمترین شاخههای هوش مصنوعی است: پردازش تصویر (Image Processing).

پردازش تصویر شاخهای از علوم کامپیوتر است که به بررسی، تحلیل و بهبود تصاویر دیجیتال میپردازد. در این فرایند، دادههای بصری مانند عکسها، ویدئوها یا تصاویر پزشکی با استفاده از الگوریتمها و تکنیکهای خاص تحلیل میشوند تا اطلاعات ارزشمندی از آنها استخراج شود یا کیفیت تصویر بهبود یابد. این حوزه، پایه و اساس بسیاری از فناوریهای مدرن مانند بینایی کامپیوتر (Computer Vision)، تشخیص الگو و یادگیری عمیق (Deep Learning) بهشمار میآید.

امروزه با گسترش شبکههای اجتماعی، دوربینها و سیستمهای هوشمند، تقریباً هر دادهای به نوعی تصویری است. در چنین دنیایی، پردازش تصویر دیگر یک مهارت تخصصی محدود نیست؛ بلکه زبانی مشترک میان انسان و ماشین است که به کمک آن میتوان تصاویر خام را به بینشی قابل استفاده تبدیل کرد.

در این مقاله، به صورت گامبهگام با مفاهیم اصلی پردازش تصویر آشنا میشوید، کاربردهای کلیدی آن را بررسی میکنیم و در نهایت در انتهای مقاله مسیر آموزش پردازش تصویر، از مبانی تا بهکارگیری هوش مصنوعی و شبکههای عصبی و سطح پیشرفته را ترسیم خواهیم کرد.

پردازش تصویر (Image Processing) چیست؟

پردازش تصویر (Image Processing)، که در برخی متون تخصصی با نام کامل پردازش تصویر دیجیتال (Digital Image Processing) نیز شناخته میشود، به مجموعهای از روشها و الگوریتمهای کامپیوتری گفته میشود که هدفشان اعمال تغییرات هدفمند و مشخص روی تصاویر دیجیتال است.

این فرآیند نقشی حیاتی در کل چرخه بینایی کامپیوتر ایفا میکند. هدف اصلی پردازش تصویر، بهبود کیفیت یک تصویر موجود یا استخراج اطلاعات مهم از آن است. این تکنیکها در کاربردهای پیشرفته مبتنی بر یادگیری عمیق (Deep Learning) اهمیتی فوقالعاده دارند، چرا که پیشپردازشهای انجام شده میتوانند عملکرد یک مدل را به شکل چشمگیری افزایش دهند.

از جمله مهمترین کاربردهایی که این فرآیند پشتیبانی میکند، میتوان به موارد زیر اشاره کرد:

- پیشپردازش (Preprocessing): آمادهسازی تصویر برای تحلیلهای بعدی (مانند حذف نویز و بهبود کنتراست).

- تشخیص چهره (Face Recognition) و تأیید هویت.

- تشخیص اشیا (Object Detection) و ردیابی آنها در فریمهای ویدئویی.

- فشردهسازی تصویر (Image Compression) برای کاهش حجم و انتقال سریعتر دادهها.

مبانی پردازش تصویر: درک تصویر در دنیای دیجیتال

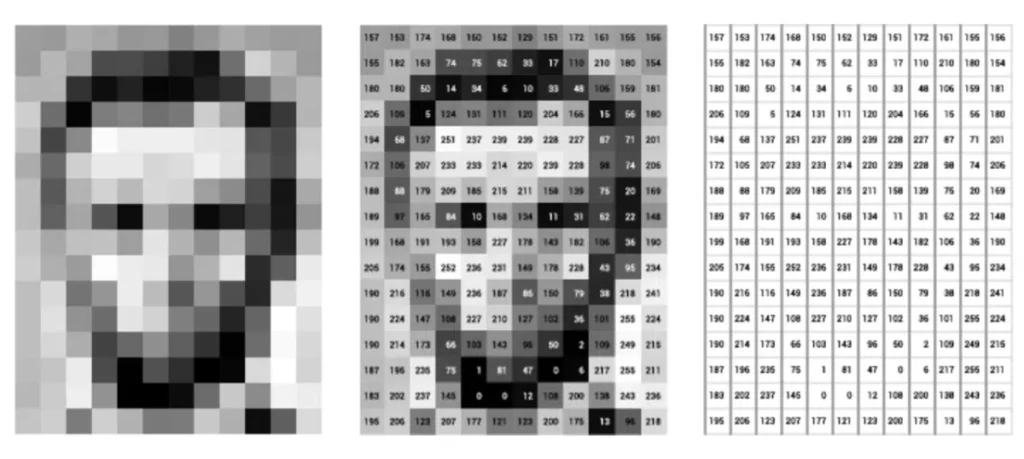

برای درک اینکه یک کامپیوتر چگونه تصاویر را پردازش میکند، ابتدا باید بدانیم که تصویر از دیدگاه ماشین چه تفاوتی با دیدگاه انسان دارد.

از نگاه ما، تصویر یک مفهوم بصری سیال، شامل رنگ، شکل و عمق است؛ اما از نگاه یک کامپیوتر، تصویر تنها یک چیز است: داده (Data).

تصویر دیجیتال چیست و چه تفاوتی با عکس آنالوگ دارد؟

در گذشته، تصاویر روی فیلمهای عکاسی (آنالوگ) ثبت میشدند که یک نمایش پیوسته از نور بود. اما امروز، تقریباً تمام تصاویری که با آنها سروکار داریم، تصاویر دیجیتال هستند.

تصویر دیجیتال، یک نمایش گسسته از دادهها است که در قالب یک ماتریس دو یا سهبعدی از اعداد ذخیره میشود.

اینجا دو مفهوم کلیدی وجود دارد که هر کاربری باید بداند:

۱. پیکسل (Pixel)

پیکسل که مخفف عبارت Picture Element است و کوچکترین جزء سازنده یک تصویر دیجیتال محسوب میشود.

هر پیکسل، یک نقطه مجزا در شبکه ماتریسی تصویر است.

اطلاعات رنگ، روشنایی و شفافیت هر نقطه از تصویر، در قالب یک یا چند عدد در داخل پیکسل ذخیره میشود.

۲. رزولوشن (Resolution)

رزولوشن تصویر، در واقع تعداد کل پیکسلهایی است که تصویر شما در ابعاد طول و عرض دارد. هر چقدر تعداد پیکسلها بیشتر باشد، جزئیات تصویر بیشتر و کیفیت آن بالاتر خواهد بود (مثلا 1920×1080 پیکسل).

پیکسلها چگونه رنگها را نمایش میدهند؟ (مفاهیم ماتریس رنگ)

اطلاعات ذخیرهشده در هر پیکسل، نوع رنگ و عمق رنگی تصویر را تعیین میکند. در پردازش تصویر، معمولاً با انواع زیر سروکار داریم:

۱. تصویر باینری (Binary Image)

به تصاویری که در آنها شدت پیکسلها تنها دو مقدار منحصربهفرد دارد، تصویر باینری گفته میشود: مقدار ۰ (برای رنگ سیاه) و مقدار ۱ (برای رنگ سفید). این نوع تصاویر معمولا برای جداسازی و تفکیک بخش مشخصی از یک تصویر رنگی به کار میروند و به طور گسترده در فرآیند بخش بندی تصویر یا Image Segmentation استفاده میشوند.

سادهترین نوع تصویر که هر پیکسل آن فقط دو حالت دارد: سیاه (۰) یا سفید (۱). این تصاویر در کاربردهایی مانند اسکن اسناد سیاه و سفید یا بازرسی صنعتی استفاده میشوند.

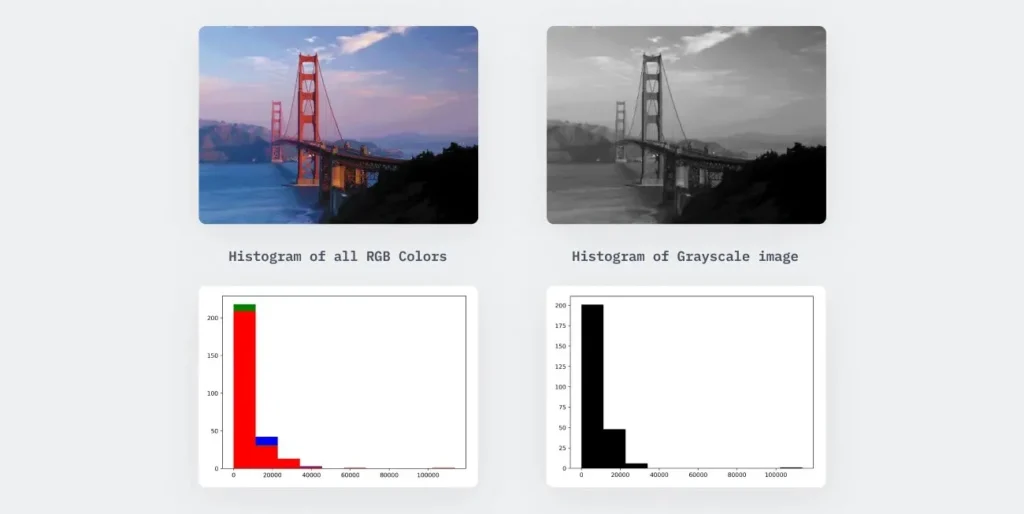

۲. تصویر مقیاس خاکستری (Grayscale Image)

تصاویر مقیاس خاکستری، که به آنها تصاویر ۸ بیتی (8bit images) نیز گفته میشود، از ۲۵۶ سطح روشنایی منحصربهفرد تشکیل شدهاند. در این تصاویر، شدت پیکسل صفر نمایانگر رنگ کاملاً سیاه و شدت ۲۵۵ نمایانگر رنگ کاملاً سفید است. ۲۵۴ مقدار باقیمانده در این بازه نیز، طیفهای مختلفی از رنگ خاکستری را نشان میدهند.

در نمونهی زیر، یک تصویر رنگی (RGB) که به نسخهی سیاهوسفید خود تبدیل شده، قابل مشاهده است:

۳. تصویر رنگی (RGB Color Image)

تصاویر رنگی RGB، رایجترین فرمت هستند و در واقع ماتریسهای ۲۴ بیتی محسوب میشوند (۸ بیت برای هر کانال). این یعنی برای هر پیکسل، امکان نمایش بیش از ۱۶ میلیون رنگ مختلف وجود دارد. واژهی «RGB» مخفف سه کانال رنگی قرمز (Red)، سبز (Green) و آبی (Blue) است.

بر خلاف تصاویر قبلی که یک کانال داشتند، در RGB، سه ماتریس هماندازه (کانال) روی یکدیگر قرار میگیرند. هر کانال مقادیری بین ۰ تا ۲۵۵ دارد:

سیاه: پیکسل در مقدار (0, 0, 0)

سفید: پیکسل در مقدار (255, 255, 255)

قرمز خالص: پیکسل در مقدار (255, 0, 0)

در تصویر زیر، یک تصویر RGB که به کانالهای تشکیلدهندهی خود تفکیک شده، نمایش داده شده است:

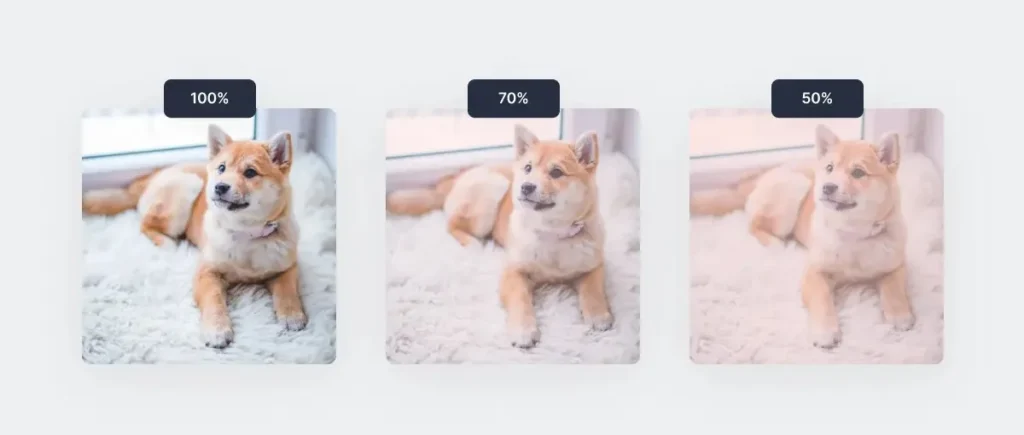

۴. تصویر RGBA

تصاویر RGBA در واقع همان تصاویر رنگی RGB هستند که یک کانال چهارم به نام آلفا (Alpha) دارند. وظیفه این کانال، مشخص کردن میزان شفافیت (Opacity) تصویر است. مقدار شفافیت در بازهای بین ۰ (کاملاً شفاف) تا ۲۵۵ (کاملاً کدر) تعریف میشود و میزان «مرئی بودن» پسزمینهی تصویر را کنترل میکند.

کانال آلفا در تصاویر RGBA دقیقاً همین ویژگی را شبیهسازی میکند. نمونهای از این کاربرد در تصویر زیر نشان داده شده است:

مراحل اصلی یک سیستم پردازش تصویر

یک سیستم پردازش تصویر دیجیتال، برای رسیدن از تصویر خام تا تصمیم نهایی هوشمند، معمولاً یک مسیر استاندارد و چند مرحلهای را دنبال میکند. درک این مراحل، نقشه راه عملکردی این حوزه است:

۱. کسب و دیجیتالی شدن تصویر (Image Acquisition)

این مرحله نقطه آغازین است. تصویر توسط یک دوربین ثبت شده و اگر سنسور خروجی دیجیتال نداشته باشد، با استفاده از یک مبدل آنالوگ به دیجیتال (ADC) دیجیتالی میشود تا برای پردازشهای کامپیوتری آماده گردد.

۲. پیشپردازش و نرمالسازی (Pre-processing)

تصاویر خام همیشه دارای نویز، اعوجاج یا مشکلات نوری هستند. هدف این گام، بهبود کیفیت دادههای ورودی برای اطمینان از عملکرد صحیح الگوریتمهای بعدی است. این عملیات شامل حذف نویز و نرمالسازی روشنایی و کنتراست است.

۳. بهبود کیفیت تصویر (Image Enhancement)

در این مرحله، تغییراتی روی تصویر اعمال میشود تا برای یک کاربرد خاص، بهینهسازی شود. هدف، برجسته کردن جزئیات پنهان است (مانند تنظیم کنتراست یا افزایش وضوح). این فرآیند کاملاً ذهنی (subjective) و وابسته به نیاز کاربر نهایی است.

۴. بازیابی تصویر (Image Restoration)

این مرحله به طور خاص به رفع تخریبهای شناختهشده در تصویر میپردازد، مانند تاری (blur) ناشی از حرکت یا مشکلات لنز. این یک عملیات عینی (objective) است؛ زیرا افت کیفیت را میتوان به یک مدل ریاضی مشخص نسبت داد (مثلاً حذف نویز با استفاده از مدلهای احتمالی).

۵. پردازش رنگ و فضاهای رنگی (Color Processing)

این گام به طور خاص به مدیریت تصاویر رنگی، شامل تصاویر 24-bit RGB و RGBA اختصاص دارد. عملیاتی مانند اصلاح رنگ (color correction)، تنظیم اشباع (Saturation) و تغییر فضاهای رنگی (مانند تبدیل RGB به HSV) در این مرحله انجام میشود.

۶. موجکها و ساختارهای چند رزولوشنی (Wavelets)

موجکها بلوکهای سازندهای ریاضی هستند که برای نمایش یک تصویر در درجات مختلفی از رزولوشن به کار میروند. تصاویر به طور متوالی به نواحی کوچکتر تقسیم میشوند تا برای کاربردهایی مانند فشردهسازی دادهها و نمایش هرمی (مانند ساختن thumbnail در جستجوی تصاویر گوگل) آماده شوند.

۷. فشردهسازی تصویر (Image Compression)

برای انتقال تصاویر به دستگاههای دیگر یا به دلیل محدودیتهای فضای ذخیرهسازی، فشردهسازی لازم است. این فرآیند حجم فایل را کاهش میدهد و در نتیجه باعث صرفهجویی در پهنای باند و سرعت نمایش میشود (مانند تبدیل به فرمت JPEG).

۸. پردازش ریختشناختی (Morphological Processing)

در این مرحله، عملیات مبتنی بر مفاهیم ریاضی شکل و فرم روی اجزای تصویر انجام میشود تا ویژگیهای هندسی اشیا استخراج شود. برای مثال، از عملیات سایش (erosion) و انبساط (dilation) برای نازک کردن یا پر کردن حفرههای اشیاء در یک تصویر استفاده میشود.

۹. بخشبندی تصویر (Image Segmentation)

این گام شامل قطعهبندی یک تصویر به قسمتهای کلیدی و معنادار است (مثلاً جداسازی مرز شیء از پسزمینه). هدف، سادهسازی نمایش و متمرکز کردن توجه سیستمهای خودکار بر روی بخشهای مهمتر تصویر است.

۱۰. بازنمایی، توصیف و تشخیص (Representation, Description, and Recognition)

پس از بخشبندی، سیستم باید شیء جدا شده را بازنمایی کرده (مثلاً به صورت یک مرز یا یک ناحیه) و ویژگیهای کلیدی آن را استخراج کند (توصیف). در نهایت، به شیء یک برچسب (label) اختصاص داده میشود تا برای کاربر انسانی یا سیستمهای هوشمند قابل تفسیر باشد (مانلاً تشخیص “خودرو” یا “شخص”).

۱۱. پایگاه دانش (Knowledge Base)

دانش نهایی و اطلاعات استخراج شده (مانند مختصات یک کادر محصور کننده (bounding box) به همراه برچسب شیء) در این پایگاه ذخیره میشوند. این اطلاعات کدگذاری شده، برای حل مسائل خاص آن کاربرد (مثلاً تصمیمگیری در مورد ترمز گرفتن یک خودروی خودران) استفاده میشود.

پردازش تصویر در برابر بینایی کامپیوتر: تفاوت در کجاست؟

اغلب مفاهیم پردازش تصویر و بینایی کامپیوتر (Computer Vision) به اشتباه به جای یکدیگر استفاده میشوند. به عنوان یک متخصص، باید بدانیم که پردازش تصویر زیربنای حوزه بینایی کامپیوتر است.

| معیار مقایسه | پردازش تصویر (Image Processing) |

بینایی کامپیوتر (Computer Vision)

|

| هدف اصلی | دستکاری (Manipulation) و بهبود تصویر ورودی. |

درک (Understanding) و استخراج معنا از تصویر.

|

| خروجی | یک تصویر بهتر (واضحتر، بدون نویز) یا یک مجموعه داده خام (مثلاً لبهها). |

یک تفسیر یا تصمیم هوشمندانه (مثلاً “تشخیص چهره موفق بود”، “مسیر حرکت عابر پیاده”).

|

| سطح تکنیک | بیشتر بر مبنای الگوریتمهای ریاضیاتی، فیلترها و تبدیلهای سنتی است. |

اغلب بر پایه الگوریتمهای پیشرفته هوش مصنوعی و یادگیری عمیق (Deep Learning) است.

|

به بیان ساده، اگر بخواهیم یک تصویر تار را واضح کنیم، از پردازش تصویر استفاده میکنیم؛ اما اگر بخواهیم بفهمیم در آن تصویر واضح چه چیزی وجود دارد و بر اساس آن تصمیم بگیریم، از بینایی کامپیوتر کمک میگیریم. پردازش تصویر، مرحله اول و زیرساخت هر سیستم بینایی کامپیوتر است.

کاربردهای پردازش تصویر در زندگی روزمره

همانطور که گفته شد، پردازش تصویر ستون فقرات بسیاری از فناوریهایی است که ما روزانه از آنها استفاده میکنیم. در اینجا به برخی از مهمترین و تأثیرگذارترین کاربردهای آن میپردازیم:

۱. پزشکی و تشخیص بیماریها

شاید حیاتیترین نقش پردازش تصویر، در حوزه سلامت باشد. الگوریتمهای پردازش تصویر به پزشکان کمک میکنند تا تصاویر پزشکی را با دقت بالاتری تفسیر کنند:

- بهبود تصاویر: افزایش وضوح و کنتراست تصاویر X-Ray، MRI و CT Scan.

- بخشبندی (Segmentation): جداسازی خودکار تومورها، رگهای خونی یا اندامهای خاص از بافتهای اطراف برای تشخیص دقیقتر بیماریهایی مانند سرطان.

۲. اتوماسیون و خودروهای خودران

زیربنای اصلی عملکرد خودروهای خودران و رباتهای صنعتی، توانایی آنها در درک محیط بصری است. پردازش تصویر نقش پیشپردازشگر این سیستمها را ایفا میکند:

- تشخیص خطوط جاده: تثبیت و بهبود تصاویر دریافتی از دوربینها برای شناسایی دقیق خطوط جاده در شرایط آب و هوایی نامساعد.

- تشخیص پلاک (ANPR): استخراج خودکار متن پلاک خودروها از تصاویر دوربینهای نظارتی.

۳. امنیت و تشخیص هویت

فناوریهای امنیتی مدرن به شدت به قابلیتهای پردازش تصویر وابستهاند تا نظارت و احراز هویت را ممکن سازند:

- تشخیص چهره: بهبود کیفیت تصاویر دریافتی از دوربینهای امنیتی و آمادهسازی آنها برای الگوریتمهای بینایی کامپیوتر (مقایسه ویژگیها برای شناسایی افراد).

- بیومتریک: اسکن، ذخیره و تطبیق الگوهای پیچیده مانند اثر انگشت یا عنبیه چشم.

۴. بهبود کیفیت تصویر و عکاسی دیجیتال

هر عملیاتی که شما برای بهبود عکسهای خود انجام میدهید، یک کاربرد مستقیم از پردازش تصویر است:

- کاهش نویز (Noise Reduction): حذف پیکسلهای تصادفی و ناهماهنگ که باعث افت کیفیت تصویر میشوند.

- افزایش وضوح و شارپ کردن: استفاده از فیلترهای ریاضی برای برجستهسازی لبهها و جزئیات تصویر (مانند عملیات فیلتر Sharpen در نرمافزارهای ویرایش عکس).

- فشردهسازی تصویر: کاهش حجم فایل (مانند فرمتهای JPEG یا PNG) با حفظ کیفیت قابل قبول.

۵. سنجش از دور و نقشهبرداری

پردازش تصویر به تحلیل دادههای ماهوارهای و هوایی کمک میکند تا اطلاعات ارزشمندی در مورد زمین به دست آید:

- پایش تغییرات محیطی: تشخیص تغییرات در پوشش گیاهی، مناطق شهری یا الگوهای آب و هوا از طریق مقایسه تصاویر ماهوارهای در طول زمان.

جمعبندی و گام بعدی یادگیری پردازش تصویر

همانطور که در این راهنما مشاهده کردید، پردازش تصویر (Image Processing) صرفاً یک ابزار ویرایش عکس نیست؛ بلکه زیربنای اصلی هوش مصنوعی در درک جهان بصری است. این دانش به کامپیوترها اجازه میدهد تا تصاویر را از یک مجموعه داده خام به یک منبع اطلاعاتی حیاتی تبدیل کنند.

برای اینکه بتوانید یک سیستم پردازش تصویر را از سطح مفاهیم پایه به یک پروژه عملی و حرفهای ارتقا دهید، نیاز به تسلط بر تکنیکهای تخصصی و مسیرهای یادگیری پیشرفته خواهید داشت.

مسیر یادگیری: از تکنیکهای کلاسیک تا Deep Learning

در سایت دیتایاد، ما نقشه راه کامل برای یادگیری پردازش تصویر را در دو بخش تخصصیتر برای شما آماده کردهایم. با توجه به علاقه و سطح تخصص خود، میتوانید ادامه مسیر یادگیری را به شکل زیر دنبال کنید:

۱. آشنایی با تکنیکهای سنتی و مراحل اجرایی

اگر به دنبال تسلط بر نحوه کارکرد الگوریتمهای سنتی پردازش تصویر، فیلترها، ترمیم و بازسازی تصویر، و مراحل گام به گام یک سیستم پردازش تصویر هستید:

👈 مطالعه گام بعدی: تکنیکهای کلاسیک پردازش تصویر و مراحل آن

۲. ورود به دنیای یادگیری عمیق و بینایی کامپیوتر

اگر هدف شما توسعه سیستمهای هوشمند، کار با مدلهایی مانند CNN و GAN، تشخیص چهره، و پروژههای پیشرفته هوش مصنوعی است، باید بر پردازش تصویر با یادگیری عمیق مسلط شوید:

👈 مطالعه گام نهایی: پردازش تصویر با یادگیری عمیق (بررسی CNN و GAN)

آغاز سفر حرفهای شما

پردازش تصویر نقطه شروعی برای هر متخصص هوش مصنوعی است. اکنون که با مفاهیم پایه و کاربردهای آن آشنا شدید، زمان آن رسیده که سفر یادگیری خود را آغاز کنید.

اگر آمادگی دارید تا تمام این مفاهیم (از مفاهیم پایه تا تکنیکهای پیشرفته Deep Learning) را به صورت پروژهمحور و عملی فرا بگیرید و وارد بازار کار هوش مصنوعی شوید:

✅ در دوره جامع آموزش پردازش تصویر با پایتون ثبت نام کنید. این دوره شامل تمام سرفصلهای کلاسیک و مباحث روز AI است و شما را از صفر به سطح یک متخصص میرساند.

سوالات متداول درباره پردازش تصویر (Image Processing)

پردازش تصویر چیست و چه کاربردی دارد؟

پردازش تصویر شاخهای از علوم کامپیوتر است که به تحلیل، بهبود و درک محتوای تصاویر دیجیتال میپردازد. هدف آن استخراج اطلاعات معنادار از دادههای تصویری است.

کاربردهای آن از تشخیص چهره در گوشیها و تحلیل تصاویر پزشکی گرفته تا خودروهای خودران و سیستمهای نظارتی گسترده است.

تفاوت پردازش تصویر با بینایی کامپیوتر در چیست؟

پردازش تصویر بر بهبود و تحلیل تصاویر تمرکز دارد، در حالی که بینایی کامپیوتر (Computer Vision) یک مرحله جلوتر است و به درک و تفسیر معنایی تصاویر توسط ماشین میپردازد.

بهعبارت دیگر، پردازش تصویر ابزار پایهای برای اجرای بینایی کامپیوتر محسوب میشود.

آیا یادگیری پردازش تصویر برای ورود به هوش مصنوعی ضروری است؟

بله. پردازش تصویر یکی از پایههای اصلی در بسیاری از پروژههای هوش مصنوعی و یادگیری عمیق است، مخصوصاً در حوزههایی مثل تشخیص اشیا، تحلیل ویدئو و پزشکی هوشمند.

یادگیری آن درک بهتری از نحوهی «درک بصری ماشینها» به شما میدهد.

چه زبانهای برنامهنویسی برای پردازش تصویر مناسبترند؟

زبانهای Python و MATLAB پرکاربردترین گزینهها هستند.

در پایتون، کتابخانههایی مثل OpenCV، scikit-image، Pillow و NumPy ابزارهای استاندارد برای پیادهسازی الگوریتمهای پردازش تصویر هستند.

آیندهی پردازش تصویر چگونه است؟

آیندهی این حوزه به شدت به یادگیری عمیق (Deep Learning) و هوش مصنوعی مولد (Generative AI) گره خورده است.

کاربردهایی مثل بازسازی تصاویر پزشکی، تولید تصاویر مصنوعی واقعگرایانه، و تحلیل بلادرنگ ویدئو در حال گسترشاند.

تقریباً هر صنعتی که با دادهی بصری سروکار دارد، در حال استفاده از پردازش تصویر است.

تفاوت پردازش تصویر دیجیتال و آنالوگ چیست؟

در پردازش تصویر دیجیتال، تصویر بهصورت دادههای عددی ذخیره و با الگوریتمهای کامپیوتری تحلیل میشود.

اما در پردازش تصویر آنالوگ (مثلاً فیلمهای قدیمی یا تصاویر نوری)، تغییرات بهصورت فیزیکی یا الکترونیکی انجام میشود.

امروزه تقریباً تمام کاربردهای صنعتی بر پایهی پردازش تصویر دیجیتال هستند.

🎓 اگر میخواهید این مسیر را بهصورت گامبهگام، عملی و پروژهمحور یاد بگیرید، دوره پردازش تصویر با پایتون در دیتایاد بهترین نقطهی شروع شماست.