شبکه عصبی پیچشی (Convolutional Neural Network یا به اختصار CNN) یکی از بنیادیترین و پرکاربردترین معماریهای یادگیری عمیق (Deep Learning) است که انقلابی بزرگ در حوزه پردازش تصویر و ویدیو ایجاد کرده است. اگر تا چند دهه قبل، تشخیص اشیا در تصاویر یا شناسایی چهره تنها در فیلمهای علمیتخیلی دیده میشد، امروز با کمک CNNها این فناوری بهصورت روزمره در گوشیهای هوشمند، خودروهای خودران، سیستمهای امنیتی و حتی پزشکی کاربرد دارد.

قدرت اصلی شبکه عصبی کانولوشن (CNN) در توانایی آن برای استخراج خودکار ویژگیها از دادههای تصویری است. برخلاف روشهای قدیمی که نیاز به طراحی دستی ویژگیها داشتند، CNN با استفاده از لایههای کانولوشن، پولینگ و لایههای کاملاً متصل میتواند الگوهای پیچیده مانند لبهها، اشکال و حتی مفاهیم انتزاعی را تشخیص دهد. به همین دلیل، CNN نهتنها در پردازش تصویر بلکه در حوزههایی مانند پردازش زبان طبیعی با پایتون، تشخیص گفتار و تحلیل ویدیو نیز جایگاه مهمی پیدا کرده است.

شبکه عصبی پیچشی (CNN) یکی از معماریهای پایه و کلیدی یادگیری عمیق (Deep Leaerning) است که توانایی استخراج خودکار ویژگیها از دادههای تصویری و ویدئویی را دارد. اگرچه مفاهیم آن پیچیده به نظر میرسند، اما با کمی تمرین میتوان مفاهیم را به شکل عملی پیادهسازی کرد. دانشجویان و توسعهدهندگان میتوانند با منابع مختلف مانند دورههای یادگیری عمیق با پایتون، گام به گام با مفاهیم شبکههای عصبی آشنا شوند و توانایی پیادهسازی CNN را در پروژههای واقعی پیدا کنند.

این مقاله یک راهنمای جامع برای دانشجویان هوش مصنوعی، توسعهدهندگان یادگیری عمیق و پژوهشگران بینایی ماشین است تا بتوانند درک عمیقتری از شبکه عصبی پیچشی پیدا کرده و در پروژههای عملی خود از آن استفاده کنند.

مقایسه CNN با دیگر شبکهها

شبکه عصبی پیچشی (CNN) به دلیل قدرت در پردازش دادههای مکانی و تصاویر، با دیگر معماریهای یادگیری عمیق تفاوتهای مهمی دارد. در ادامه، مقایسه شبکه عصبی بازگشتی (RNN) و مدلهای ترنسفورمر (Transformer) آورده شده است:

CNN vs RNN (پردازش تصویر vs پردازش دنباله)

|

ویژگی |

CNN | RNN |

| نوع داده | تصاویر و دادههای مکانی |

دادههای ترتیبی و دنبالهای (مثل متن، صوت) |

|

ارتباط بین نقاط |

محلی (با فیلترهای کانولوشن) | ترتیبی (وابستگی زمانی بین گامها) |

| زمان آموزش | سریعتر به دلیل وزنهای مشترک و موازیسازی |

کندتر، به خصوص در دنبالههای بلند |

|

کاربرد اصلی |

طبقهبندی تصویر، تشخیص اشیاء |

ترجمه زبان، پردازش گفتار، پیشبینی سری زمانی |

مقایسه ی بعدی:

|

ویژگی |

CNN | Transformers |

| نوع داده | تصاویر، ویدیو |

تصاویر، متن، صوت، دادههای ترکیبی |

|

وابستگی |

محلی (با فیلترها) | جهانی (Self-Attention برای همه نقاط داده) |

| توانایی استخراج ویژگی | بسیار خوب برای ویژگیهای محلی |

مناسب برای یادگیری وابستگیهای بلندمدت و جهانی |

|

پیچیدگی محاسباتی |

کمتر | بیشتر (به خصوص برای تصاویر بزرگ) |

| کاربرد | پردازش تصویر کلاسیک |

NLP، Vision Transformer (ViT)، مدلهای چندرسانهای |

- CNN: بهترین انتخاب برای تصاویر و دادههای مکانی با وابستگی محلی.

- RNN: مناسب دادههای دنبالهای و زمانی.

- Transformers: توانایی بالایی در یادگیری وابستگیهای طولانی و دادههای ترکیبی دارد و در حال ورود گسترده به حوزه بینایی کامپیوتر است.

به نقل از سایت ibm:

«شبکههای عصبی زیرمجموعهای از یادگیری ماشین هستند و در قلب الگوریتمهای یادگیری عمیق قرار دارند. آنها از لایههای گره تشکیل شدهاند که شامل یک لایه ورودی، یک یا چند لایه پنهان و یک لایه خروجی هستند. هر گره به گره دیگری متصل میشود و دارای وزن و آستانه مرتبط است. اگر خروجی هر گره بالاتر از مقدار آستانه مشخص شده باشد، آن گره فعال میشود و دادهها را به لایه بعدی شبکه ارسال میکند. در غیر این صورت، هیچ دادهای به لایه بعدی شبکه منتقل نمیشود.»

CNN چیست و چرا انقلابی در پردازش تصویر ایجاد کرد؟

شبکه عصبی پیچشی (Convolutional Neural Network – CNN) یک معماری ویژه از شبکههای عصبی مصنوعی است که برای کار با دادههای تصویری طراحی شده است. ایده اصلی آن بر پایه شبیهسازی نحوه عملکرد قشر بینایی مغز انسان بنا شده؛ جایی که نورونها به صورت لایهلایه الگوهای بصری را پردازش میکنند.

در شبکههای عصبی سنتی (MLP یا Perceptron چندلایه)، هر نورون به تمام نورونهای لایه قبلی متصل میشود. این موضوع باعث میشود که وقتی ورودی یک تصویر با ابعاد بزرگ (مثلاً 256×256 پیکسل) باشد، تعداد پارامترها به شکل انفجاری افزایش یابد. چنین مدلی هم از نظر محاسباتی بسیار سنگین است و هم خطر Overfitting بالایی دارد.

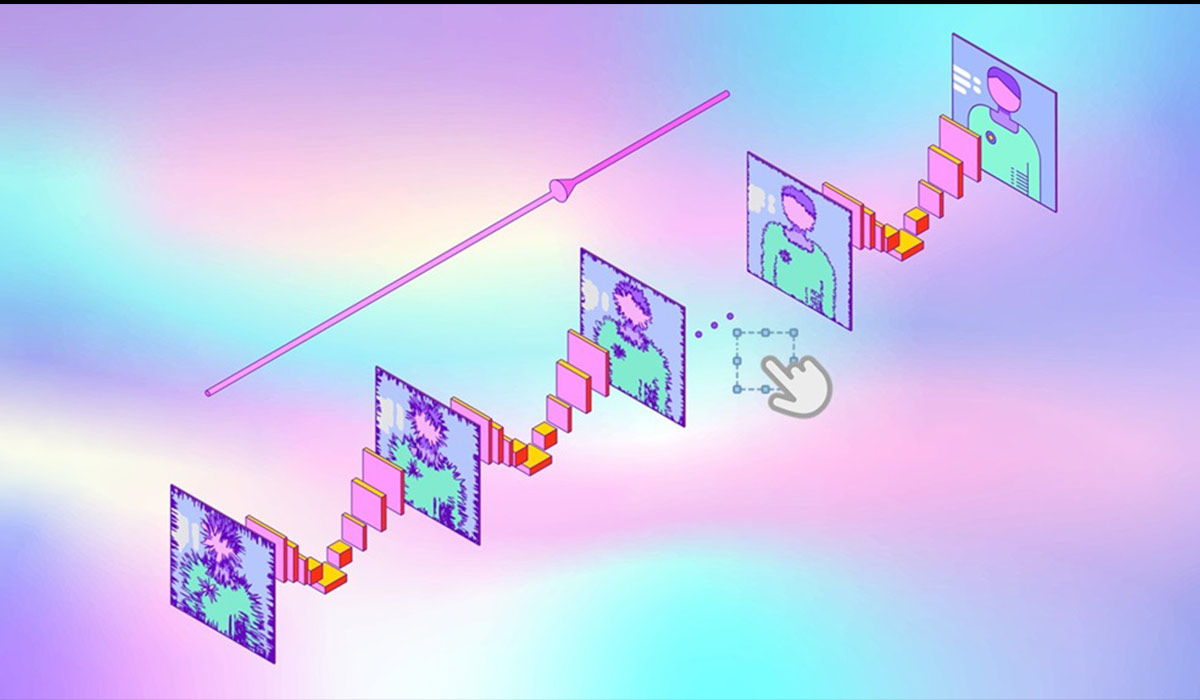

CNNها این مشکل را با معرفی لایههای کانولوشن (Convolutional Layers) حل کردند. در این لایهها، بهجای اتصال کامل، از فیلترهای کوچک (Kernel) استفاده میشود که تنها بخشی از تصویر را بررسی کرده و ویژگیهای محلی مثل لبهها، خطوط یا بافتها را شناسایی میکنند. سپس، با ترکیب این ویژگیهای محلی در چندین لایه، مدل میتواند الگوهای پیچیدهتر مانند چهره انسان یا اشیاء مختلف را یاد بگیرد.

به همین دلیل، CNNها توانستند در زمینههایی مثل:

- طبقه بندی اشیا (Image Classification)

- تشخیص چهره در سیستمهای امنیتی و موبایلها

- پردازش تصویر در پزشکی برای تشخیص تومورها و بیماریها

- خودروهای خودران برای درک محیط اطراف

- و حتی پردازش زبان طبیعی با پایتون در ترکیب با دیگر تکنیکها

بهعنوان یک فناوری انقلابی شناخته شوند.

برای دریافت راهنمایی تخصصی در انتخاب بهترین دوره آموزشی متناسب با نیازتان، کارشناسان آموزشی ما آماده پاسخگویی و مشاوره هستند. با شماره ۰۹۹۰۵۵۰۱۹۹۸ ارتباط بگیرید.

مقایسه CNN با شبکههای عصبی معمولی (MLP)

برای درک بهتر اینکه چرا شبکه عصبی پیچشی (CNN) اینقدر محبوب و قدرتمند شد، باید آن را با شبکههای عصبی کلاسیک یا همان MLP (Multi-Layer Perceptron) مقایسه کنیم.

1. نحوه اتصال نورونها

- MLP: هر نورون به تمام نورونهای لایه قبلی متصل است (اتصال کامل – Fully Connected). این باعث افزایش سریع تعداد پارامترها میشود.

- CNN: فقط بخشی از ورودی (یک پنجره کوچک یا Kernel) را پردازش میکند. بنابراین تعداد پارامترها بسیار کمتر است و مدل سریعتر آموزش میبیند.

2. پردازش تصاویر

- MLP: تصویر دوبعدی باید به یک بردار یکبعدی (Flatten) تبدیل شود. در این فرایند، ساختار مکانی تصویر (Spatial Information) از بین میرود.

- CNN: بدون نیاز به Flatten کامل، تصویر را به صورت ماتریسی پردازش میکند و موقعیت پیکسلها حفظ میشود. این یعنی مدل میتواند الگوهای مکانی مثل لبهها و اشکال را بشناسد.

3. تعداد پارامترها

- MLP: برای یک تصویر رنگی 256×256×3 (حدود 200 هزار پیکسل)، حتی یک لایه پنهان ساده با 1000 نورون نیاز به 200 میلیون پارامتر دارد.

- CNN: با یک Kernel کوچک 3×3 یا 5×5 فقط چند ده پارامتر تعریف میشود و همان Kernel بارها روی تصویر حرکت میکند (وزنهای مشترک).

4. عملکرد در پردازش تصویر

- MLP: برای مسائل ساده مثل طبقهبندی دادههای جدولی خوب است ولی در تصاویر، دقت پایینی دارد.

- CNN: در پردازش تصویر و ویدیو استاندارد طلایی محسوب میشود و تقریباً در تمام رقابتهای بینالمللی بینایی ماشین برنده است.

CNNها به دلیل استفاده از فیلترهای محلی، وزنهای مشترک و حفظ ساختار مکانی دادهها، برای پردازش تصویر بسیار مناسبتر از MLP هستند.

نقش لایههای کانولوشن در تشخیص الگو

لایه کانولوشن (Convolutional Layer) قلب تپندهی یک شبکه عصبی پیچشی است. وظیفهی اصلی این لایه، استخراج ویژگیها (Feature Extraction) از دادههای ورودی است؛ بهطوریکه شبکه بتواند الگوهای ساده و سپس الگوهای پیچیدهتر را یاد بگیرد.

1. فیلترها (Kernel یا Filter)

- فیلترها ماتریسهای کوچکی هستند (مثلاً 3×3 یا 5×5) که روی تصویر حرکت میکنند(Sliding Window).

- هر فیلتر یک ویژگی خاص را شناسایی میکند؛ مثلاً یک فیلتر میتواند لبههای افقی را تشخیص دهد و دیگری لبههای عمودی.

2. عملیات کانولوشن

- در هر حرکت، مقادیر پیکسلهای تصویر با مقادیر فیلتر ضرب شده و جمع میشوند.

- خروجی این عملیات، یک نقشه ویژگی (Feature Map) است که نشان میدهد آن ویژگی خاص در کدام بخش تصویر وجود دارد.

3. یادگیری خودکار ویژگیها

- برخلاف روشهای سنتی پردازش تصویر که باید دستی ویژگیها طراحی میشدند، در CNN وزنهای فیلترها بهطور خودکار در طول آموزش یاد گرفته میشوند.

- لایههای ابتدایی معمولاً ویژگیهای ساده مثل لبهها و گوشهها را یاد میگیرند.

- لایههای میانی الگوهای پیچیدهتر مثل بافتها یا اشکال هندسی را تشخیص میدهند.

- لایههای انتهایی میتوانند مفاهیم سطح بالا مثل چهره، خودرو یا حیوان را شناسایی کنند.

4. نقش Stride و Padding

- Stride مشخص میکند فیلتر در هر حرکت چند پیکسل جابهجا شود. Stride بزرگتر یعنی خروجی کوچکتر اما پردازش سریعتر.

- Padding تعیین میکند آیا لبههای تصویر با صفر یا مقادیر دیگر پر شوند تا فیلتر بتواند کل تصویر را پوشش دهد.

در نتیجه لایههای کانولوشن، قابلیت اصلی CNN در تشخیص خودکار الگوها را فراهم میکنند. به همین دلیل، CNN میتواند بدون دخالت انسان، از دادهی خام به نمایشهای معنایی غنی برسد.

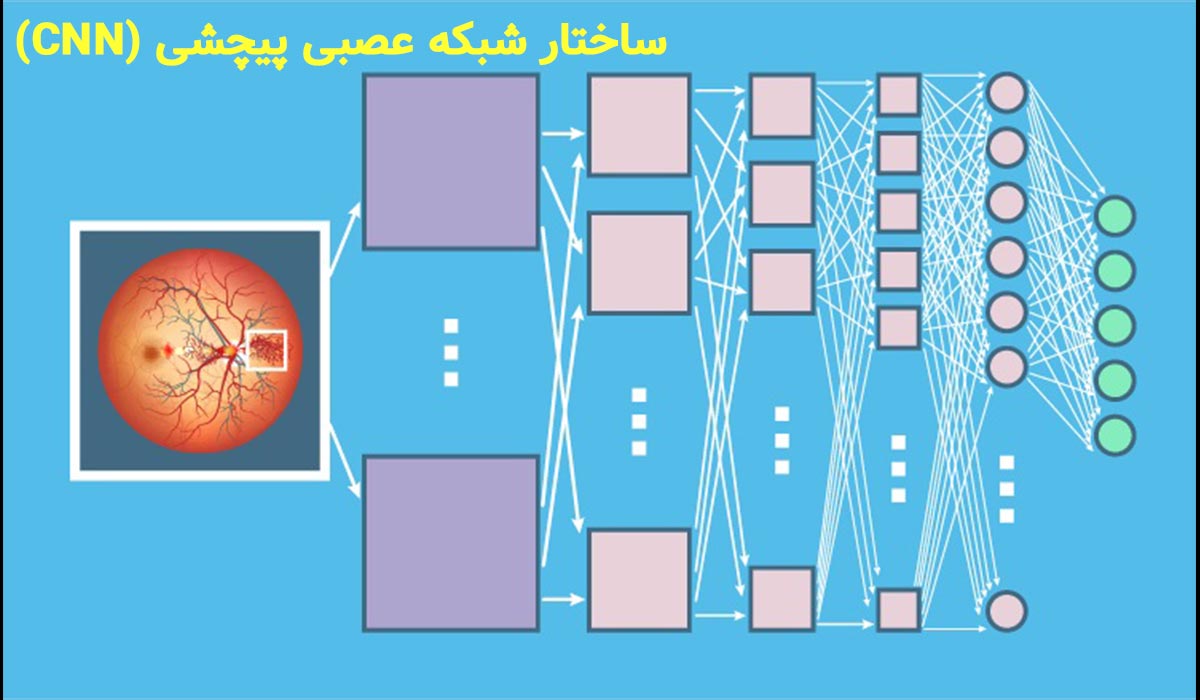

ساختار شبکه عصبی پیچشی (CNN)

شبکه عصبی پیچشی از چندین لایهی تخصصی تشکیل شده است که هرکدام نقش خاصی در پردازش دادهها دارند. ترکیب این لایههاست که CNN را قدرتمند میسازد. در ادامه، مهمترین لایههای CNN را مرحله به مرحله بررسی میکنیم:

1. لایه پیچشی (Convolutional Layer)

- همانطور که گفتیم، این لایه وظیفهی استخراج ویژگیها را برعهده دارد.

- با استفاده از فیلترها (Kernel)، بخشهای مختلف تصویر بررسی شده و نقشههای ویژگی ساخته میشوند.

- هرچه تعداد فیلترها بیشتر باشد، ویژگیهای متنوعتری شناسایی میشوند.

- مثال: یک تصویر گربه، ممکن است در لایه اول لبههای گوش و در لایه دوم بافت مو استخراج شود.

2. لایه فعالسازی (Activation Layer)

- بعد از کانولوشن، خروجی از یک تابع فعالسازی عبور میکند.

- پرکاربردترین تابع در CNNها، ReLU (Rectified Linear Unit) است.

- فرمول:

f(x)=max(0,x)f(x) = \max(0, x)f(x)=max(0,x)

- دلیل استفاده:

- غیرخطی کردن مدل

- جلوگیری از مشکلات گرادیان ناپدیدشونده

- محاسبات ساده و سریع

3. لایه ادغام (Pooling Layer)

- هدف: کاهش ابعاد ویژگیها و در نتیجه کاهش تعداد پارامترها.

- دو نوع اصلی:

- Max Pooling → بیشترین مقدار در هر ناحیه انتخاب میشود.

- Average Pooling → میانگین مقادیر انتخاب میشود.

- مثال: اگر یک فیلتر 2×2 روی تصویر حرکت کند، ابعاد نقشه ویژگی نصف میشود.

- مزایا:

- کاهش حجم محاسبات

- جلوگیری از Overfitting

- افزایش مقاومت مدل در برابر جابهجاییهای کوچک تصویر

4. لایه کاملاً متصل (Fully Connected Layer)

- پس از چندین لایه کانولوشن و پولینگ، دادهها بهصورت بردار یکبعدی تبدیل میشوند.

- این بردار وارد لایههای Fully Connected (Dense Layers) میشود.

- وظیفه این لایهها: طبقهبندی نهایی.

- مثال: اگر مسئله ما تشخیص تصویر سگ یا گربه باشد، خروجی این لایه احتمال تعلق تصویر به هر کلاس را میدهد.

معماری CNN معمولاً به این صورت است:

ورودی تصویر → لایه کانولوشن → لایه فعالسازی → لایه پولینگ → تکرار چند بار → لایههای Fully Connected → خروجی (کلاسبندی).

پیادهسازی CNN با پایتون (کد کامل)

در این بخش، یک شبکه عصبی پیچشی ساده را با استفاده از کتابخانهی TensorFlow/Keras پیادهسازی میکنیم. هدف، یادگیری پایه و درک عملی مفاهیم قبلی است.

1. نصب و وارد کردن کتابخانهها

!pip install tensorflow matplotlib import tensorflow as tf from tensorflow.keras import layers, models import matplotlib.pyplot as plt

2. بارگذاری و آمادهسازی دادهها

برای مثال از مجموعه داده MNIST (اعداد دستنویس) استفاده میکنیم:

# بارگذاری دادهها (x_train, y_train), (x_test, y_test) = tf.keras.datasets.mnist.load_data() # نرمالسازی دادهها بین 0 و 1 x_train, x_test = x_train / 255.0, x_test / 255.0 # اضافه کردن کانال بعدی برای CNN (MNIST تک کاناله است) x_train = x_train[..., tf.newaxis] x_test = x_test[..., tf.newaxis]

3. تعریف معماری شبکه CNN

model = models.Sequential() # لایه کانولوشن ReLU model.add(layers.Conv2D(32, (3,3), activation='relu', input_shape=(28,28,1))) # لایه پولینگ model.add(layers.MaxPooling2D((2,2))) # لایه کانولوشن دوم model.add(layers.Conv2D(64, (3,3), activation='relu')) model.add(layers.MaxPooling2D((2,2))) # لایه کانولوشن سوم model.add(layers.Conv2D(64, (3,3), activation='relu')) # تبدیل به بردار یک بعدی model.add(layers.Flatten()) # لایه Fully Connected model.add(layers.Dense(64, activation='relu')) # لایه خروجی با 10 کلاس (اعداد 0 تا 9) model.add(layers.Dense(10, activation='softmax'))

4. کامپایل مدل

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

5. آموزش مدل

history = model.fit(x_train, y_train, epochs=5, validation_data=(x_test, y_test)

6. ارزیابی و نمایش نتایج

test_loss, test_acc = model.evaluate(x_test, y_test)

(f'دقت نهایی روی مجموعه تست: {test_acc*100:.2f}%')print

نکات عملی:

- تعداد فیلترها و اندازه Kernel میتواند با توجه به پیچیدگی مسئله تغییر کند.

- تعداد لایهها نیز بسته به حجم داده و سختی مسئله قابل افزایش است.

- برای مسائل واقعی پردازش تصویر، معمولاً از دادههای رنگی (RGB) و تصاویر بزرگتر استفاده میشود.

هنگام آموزش یک شبکه CNN روی تصاویر، نکته مهم آمادهسازی دادهها و تحلیل آنهاست. پیش از اعمال لایههای کانولوشن و پولینگ، معمولاً دادهها نرمالسازی میشوند و ابعادشان بررسی میشود. به عنوان مثال، در پردازش مجموعه داده MNIST، میتوان از تکنیکهایی برای تحلیل داده با پایتون استفاده کرد تا ورودیها آماده و مدل سریعتر آموزش ببیند. همچنین برای پروژههای پردازش تصویر، منابعی مانند پردازش تصویر با پایتون میتوانند دانش عملی و مهارتهای کدنویسی را تقویت کنند.

کاربردهای شبکه عصبی پیچشی (CNN)

شبکه عصبی پیچشی به دلیل توانایی فوقالعاده در استخراج ویژگیها از دادههای تصویری و ویدئویی، در صنایع و حوزههای مختلف کاربردهای گستردهای دارد. در ادامه مهمترین کاربردها را بررسی میکنیم:

1. تشخیص تصویر و طبقهبندی

- شناسایی اشیاء و افراد در تصاویر و ویدیوها

- مثال: تشخیص گربه، سگ یا خودرو در تصاویر

2. پردازش تصاویر پزشکی

- تشخیص تومور، بیماریها و ناهنجاریها در تصاویر پزشکی

- به پزشکان کمک میکند سریعتر و دقیقتر تشخیص دهند

3. پردازش زبان طبیعی (NLP)

- CNNها میتوانند ویژگیهای محلی متن را استخراج کنند

- در تحلیل متن، طبقهبندی احساسات و تشخیص اسپم کاربرد دارند

4. تشخیص چهره

- استفاده در سیستمهای امنیتی و دوربینهای هوشمند

- مثال: ورود بدون کلید، احراز هویت کاربران

5. تشخیص گفتار

- استخراج ویژگیها از موجهای صوتی و تشخیص کلمات

- ترکیب CNN با تکنیکهای دیگر در سیستمهای دستیار صوتی

6. بازیهای کامپیوتری و واقعیت مجازی

- شناسایی محیط و تعامل با بازیکن

- مثال: ردیابی حرکت دست و بدن برای کنترل بازی

7. خودروهای خودران

- شناسایی موانع، علائم راهنمایی و رانندگی و مسیر حرکت

- افزایش امنیت و دقت سیستمهای رانندگی خودکار

بهینهسازی CNN برای پردازش سریعتر

برای اینکه شبکههای عصبی پیچشی بتوانند سریعتر آموزش ببینند و در عمل پیشبینی کنند، چندین روش بهینهسازی وجود دارد. در ادامه، مهمترین راهکارها به صورت لیست وار آورده شده است:

- استفاده از Batch Normalization

- استانداردسازی خروجی هر لایه قبل از فعالسازی

- کمک به سرعت بالاتر آموزش و پایداری گرادیانها

- استفاده از Dropout

- تصادفی غیرفعال کردن برخی نورونها در طول آموزش

- جلوگیری از Overfitting و کاهش محاسبات غیرضروری

- کاهش ابعاد با Pooling یا Stride بزرگتر

- کاهش تعداد نورونها و وزنها

- کاهش هزینه محاسباتی

- استفاده از معماریهای سبک و بهینه (Lightweight CNN)

- مثالها: MobileNet، SqueezeNet

- مناسب برای دستگاههای با قدرت پردازشی محدود مثل موبایل

- استفاده از تکنیکهای Data Augmentation

- افزایش دادههای آموزشی بدون افزایش حجم واقعی داده

- بهبود یادگیری و کاهش نیاز به شبکههای بسیار بزرگ

- استفاده از تکنیکهای Quantization و Pruning

- کاهش دقت محاسباتی و حذف وزنهای کم اهمیت

- کاهش حجم مدل و سرعت بخشیدن به پیشبینی

- استفاده از GPU یا TPU

- محاسبات موازی برای عملیات ماتریسی

- افزایش سرعت آموزش چندین برابر نسبت به CPU

- استفاده از Learning Rate مناسب و Optimizerهای پیشرفته

- مثالها: Adam، RMSProp

- کمک به همگرایی سریعتر و کاهش تعداد Epochها

با ترکیب این تکنیکها میتوان شبکههای CNN سریعتر، کمحجمتر و دقیقتر ایجاد کرد، بهطوری که برای کاربردهای واقعی مثل پردازش ویدیو، خودروهای خودران و موبایل کاملاً مناسب باشند.

خطاهای رایج در طراحی CNN

طراحی شبکههای عصبی پیچشی اگرچه قدرتمند است، اما مستعد برخی اشتباهات متداول است که میتواند عملکرد مدل را کاهش دهد یا آموزش را مشکل کند. در ادامه، مهمترین این خطاها را بررسی میکنیم:

1. استفاده از شبکه خیلی بزرگ برای داده کم

- مشکل: Overfitting و یادگیری نویز به جای ویژگیهای واقعی

- راهکار: کاهش تعداد فیلترها و لایهها یا استفاده از Dropout و Data Augmentation

2. نادرست تنظیم کردن Stride و Padding

- مشکل: خروجی بسیار کوچک یا از دست رفتن اطلاعات لبهها

- راهکار: بررسی ابعاد Feature Map و استفاده از Padding مناسب (Same یا Valid)

3. انتخاب نادرست تابع فعالسازی

- مشکل: استفاده از توابع غیرخطی نامناسب میتواند باعث گرادیان ناپدیدشونده شود

- راهکار: استفاده از ReLU یا مشتقات آن (Leaky ReLU، ELU)

4. نرمالسازی دادهها انجام نشده

- مشکل: آموزش کند یا عدم همگرایی مدل

- راهکار: نرمالسازی ورودیها به محدوده [0,1] یا [-1,1]

5. تعداد زیاد یا کم فیلترها

- مشکل: تعداد کم → استخراج ویژگی ناکافی، تعداد زیاد → محاسبات سنگین

- راهکار: شروع با فیلترهای کوچک و افزایش تدریجی تعداد آنها

6. عدم استفاده از تکنیکهای کاهش ابعاد (Pooling)

- مشکل: افزایش بیش از حد پارامترها و محاسبات

- راهکار: استفاده مناسب از MaxPooling یا AveragePooling

7. استفاده نادرست از دادهها و برچسبها

- مشکل: آموزش با دادههای اشتباه یا برچسبهای نادرست

- راهکار: بررسی و پاکسازی دادهها قبل از آموزش

با رعایت نکات فوق و طراحی دقیق معماری، شبکه CNN میتواند دقیق و پایدار باشد و از مشکلات رایج جلوگیری شود.

جمعبندی

شبکه عصبی پیچشی (CNN) یکی از پیشرفتهترین و کاربردیترین معماریهای یادگیری عمیق است که بهطور ویژه برای پردازش دادههای تصویری طراحی شده است. قدرت اصلی CNN در توانایی آن برای استخراج خودکار ویژگیها از تصاویر و ویدیوها نهفته است، بهطوری که دیگر نیازی به طراحی دستی ویژگیها نیست.

همچنین بطور کلی میتوان گفت ، میتوان گفت که شبکه عصبی پیچشی ابزار قدرتمند و منعطفی برای یادگیری ویژگیهای پیچیده تصاویر و دادههای چندبعدی است. با رعایت اصول طراحی، انتخاب مناسب معماری و بهینهسازی، CNN میتواند در پروژههای عملی و صنعتی، از پردازش تصاویر پزشکی تا خودروهای خودران و سیستمهای هوشمند، عملکردی دقیق و سریع ارائه دهد.

در نهایت، شبکه عصبی پیچشی (CNN) ابزاری قدرتمند برای استخراج ویژگیها و پردازش دادههای تصویری و ویدئویی است. یادگیری و کار با این شبکهها بدون درک عملی دشوار خواهد بود. منابع آموزشی همچون آموزش هوش مصنوعی از صفر میتوانند نقطه شروع مناسبی برای دانشجویان و پژوهشگران باشند تا مسیر یادگیری را به شکل اصولی و مرحلهای طی کنند. با تمرین و پروژههای عملی، میتوان از CNN برای کاربردهای صنعتی و علمی مختلف بهره گرفت و مهارتهای خود را در حوزه بینایی ماشین و پردازش تصویر با پایتون تقویت کرد.

برای دریافت راهنمایی تخصصی در انتخاب بهترین دوره آموزشی متناسب با نیازتان، کارشناسان آموزشی ما آماده پاسخگویی و مشاوره هستند. با شماره ۰۹۹۰۵۵۰۱۹۹۸ ارتباط بگیرید.

سوالات متداول

1. تفاوت Padding و Stride چیست؟

- Stride: مشخص میکند فیلتر هنگام حرکت روی تصویر چند پیکسل جابهجا شود.

- Stride بزرگ → خروجی کوچکتر، محاسبات کمتر

- Stride کوچک → خروجی بزرگتر، جزئیات بیشتر

- Padding: مشخص میکند چه مقدار لبههای تصویر با صفر یا مقدار دیگری پر شود تا اندازه تصویر حفظ شود یا کاهش یابد.

- Same Padding → خروجی همان اندازه ورودی

- Valid Padding → بدون پرکردن لبهها

2. چرا از چند لایه کانولوشن استفاده میکنیم؟

- لایههای اولیه → استخراج ویژگیهای ساده مثل لبهها و خطوط

- لایههای میانی → شناسایی الگوهای پیچیدهتر مثل بافتها و شکلها

- لایههای انتهایی → درک مفاهیم سطح بالا مثل چهره، خودرو یا حیوان

3. آیا CNN فقط برای تصاویر کاربرد دارد؟

خیر. CNNها در زمینههای زیر نیز کاربرد دارند:

- پردازش صوت و گفتار

- تحلیل دادههای سری زمانی

- پردازش زبان طبیعی با پایتون

4. چگونه میتوان سرعت آموزش CNN را افزایش داد؟

- استفاده از GPU یا TPU

- بهینهسازی معماری و کاهش تعداد پارامترها

- تکنیکهای Dropout و Batch Normalization

- استفاده از معماریهای سبک مانند MobileNet